Visualitzant el que oculten els algorismes

- Encara que la paraula algorisme és relativament coneguda, la societat en general no sap què són ni per a què s'utilitzen. A partir de la seva importància en l'àmbit de la intel·ligència artificial, Lore Martinez Axpe, secretària i parlamentària de digitalització d'EH Bildu, ha explicat que Hodei, creada per l'empresa Iametza, no existeix en el podcast. S'ha acordat en el Parlament Basc la creació d'un registre públic dels algorismes que utilitza el Govern Basc, i entorn d'aquest projecte s'ha treballat en el programa de ràdio, així com les possibilitats i riscos de la intel·ligència artificial, entre altres.

En el text acordat per PNB, EH Bildu, PSE-EE e Elkarrekin Podem s'insta el Govern Basc a aprovar una Declaració Ètica de la Dada com a garantia de principis ètics i valors que guiïn l'ús de les dades en l'administració pública. Es crearà un registre públic transparent que abasti tots els algorismes i sistemes d'intel·ligència artificial que utilitza l'administració, així com els proveïdors que aquesta subcontracta. L'acord es basa en la moció presentada per Lore Martinez Axpe.

Resultats “discriminatoris”

En essència, la intel·ligència artificial seria la “presa de decisions” o l'alimentació d'ordinadors amb milions de dades d'enorme capacitat computacional, el processament dels mateixos mitjançant algorismes i la identificació de patrons. Els algorismes són operacions o procediments que es realitzen per a buscar una solució. Quin és un dels problemes? Els resultats poden ser sovint “discriminatoris”, segons Martínez. Això també és aplicable a l'administració pública. És a dir, quan parlem d'inundació de dades d'intel·ligència artificial cal tenir en compte que els algorismes que processen aquesta informació poden discriminar la ciutadania.

Per posar un exemple: Un estudi realitzat per Algorithm Watch va concloure que l'Ertzaintza utilitza un sistema xenòfob per a mesurar el risc de la violència masclista. L'algorisme EPV-R es basa en un qüestionari psicològic en el qual es pregunta si són víctimes o delinqüents “estrangers”, entre altres. A més, el qüestionari només sona com a estranger a no occidentals. L'inspector general de l'Ertzaintza, Oskar Fernández, va explicar que en aquesta categoria s'inclouen “aquells que no són europeus amb cultura diferent”.

Així mateix, la Universitat Cornel dels EUA va analitzar el rendiment d'EPV-R i va concloure que la majoria dels casos considerats com “d'alt risc” per altres vies (53%) eren “de baix risc”. És a dir, existeix un alt risc que aquest algorisme no es valori com a “casos greus”.

Denegació de subvencions

Aquestes intel·ligències artificials també poden prendre decisions que afecten l'economia de la ciutadania. Una d'elles és Bosco, que regula el bo social per al pagament de la factura elèctrica. Intervé en la revisió de les sol·licituds i té competència per a decidir el resultat. El grup Civio va denunciar algunes discriminacions de l'algorisme per excloure a alguns sectors amb dret a ajuda.

Podran optar a aquesta subvenció les rendes baixes, la família nombrosa o la persona beneficiària d'una pensió mínima d'incapacitat o jubilació. Una vídua hauria de triar aquesta última, però Bosco considera que el procediment és “incalculable” i és el missatge que transmeten a les empreses elèctriques. Així, nega l'ajuda a les vídues, encara que els correspon rebre-la. Els membres de famílies nombroses, qualsevol que sigui la seva renda, tenen dret legalment a aquesta ajuda. No obstant això, Bosco ha d'analitzar la renda dels sol·licitants i si algú no permet analitzar els seus comptes, no se li dona aquesta ajuda perquè deixa fora d'algorismes.

Martínez explica que els algorismes poden “augmentar exponencialment” la discriminació en funció de la intel·ligència artificial que se'ls apliqui. “Per això és tan important preparar bé les dades amb els algorismes. Hem de procurar que les dades no siguin discriminatoris i que tinguin una bona base per a accedir a l'algorisme”.

Registre públic d'algorismes

Què serà el que els ciutadans podran consultar? Bàsicament tindran dret a conèixer on i per a què s'han utilitzat les dades personals. El parlamentari d'EH Bildu ha portat un exemple al podcast. Suposem que algú ha patit una malaltia i que ha utilitzat les seves dades per a preveure les condicions que han de complir les persones que l'han patit per a tornar a emmalaltir. El propietari d'aquestes dades podrà conèixer si aquestes dades han tingut efectes discriminatoris. A més, si algú no està conforme amb donar aquest ús a les seves dades, se l'informarà de com pot apel·lar.

Tots els ciutadans poden conèixer el que s'ha fet amb les dades personals, però molts encara no saben què és un algorisme. Per això, Martínez ha donat importància al llenguatge utilitzat: “Ha d'explicar-se de manera que la ciutadania ho entengui. El registre no és per a consulta d'informàtics sinó per a consulta de qualsevol persona”.

Creació del registre públic “0. és només una "fase", segons el parlamentari d'EH Bildu. “El major benefici és que hem començat a socialitzar la qüestió dels algorismes. Conèixer com es treballen les nostres dades és un dret fonamental dels ciutadans, si bé encara queda molt per fer”. Martínez considera que les auditories són necessàries per a demostrar que compleixen amb el promès i que no hi ha discriminació.

Comunitat Autònoma Primera

La CAPV ha estat la primera comunitat autònoma de l'Estat a aprovar el registre públic d'algorismes. No obstant això, hi ha més casos en algunes ciutats europees: Barcelona, Hèlsinki i Amsterdam. Després de consultar amb la comissió d'intel·ligència artificial de la Unió Europea la proposta d'EH Bildu en el Parlament Basc, Martínez explica que, segons els van dir els membres de la comissió, l'elaboració de registres públics serà una “tendència” també en la resta d'Europa.

Destaca la de la capital catalana. A l'abril, quatre experts en la creació d'un registre públic d'algorismes en l'administració, entre ells Michael Donaldson, representant d'Innovació Tecnològica, Administració Electrònica i Bon Govern de l'Ajuntament de Barcelona, van parlar en el Parlament Basc i van informar sobre el cas de Barcelona.

Va explicar com a la fi de l'any 2022 l'ajuntament va aprovar un protocol que definia les mesures necessàries abans i després d'utilitzar un algorisme. El protocol estableix que abans d'utilitzar un sistema algorítmic de prestació de servei públic, el servei informàtic haurà de realitzar una avaluació de riscos. Considera d'alt risc els processos que afectin els drets socials o a les dades dels ciutadans, així com els que puguin suposar discriminacions en la concessió de subvencions.

Abans de provar-ho, al mercat

Martínez adverteix del risc de no provar la tecnologia. “Tenim una gran tendència a ser progressistes amb la tecnologia i utilitzem els nous productes sense reflexió prèvia. Estem investigant, innovant, traient noves solucions tecnològiques digitals i les llancem al mercat res més renovar-les”. Comparativa amb medicaments. “Els medicaments també s'investiguen i innoven, però abans de sortir al mercat es realitzen milers de proves per a conèixer les seves conseqüències, que després es plasmen en un prospecte. Aquest prospecte explica els danys i riscos d'aquest medicament”. En opinió de la parlamentària, la intel·ligència artificial hauria d'actuar de la mateixa manera: “Una vegada que el producte sigui present, cal preguntar: 'Quins danys té? Garanteix la llei de protecció de dades? És discriminatòria?’.

Diu que van actuar igual amb la intel·ligència artificial ChatGPT: “En quatre mesos van finalitzar el producte i el van comercialitzar directament”. Aquesta eina no compleix la llei de protecció de dades, per la qual cosa ha estat prohibida a Itàlia després de la seva comercialització. “Jo crec que això calia fer-ho des del principi. No s'ha de deixar comercialitzar tecnologia si no està provada prèviament”. Considera que aquest treball és responsabilitat de l'empresa: “Una empresa no hauria de comercialitzar alguna cosa que pugui perjudicar les persones”.

Què hi ha a Euskal Herria?

Martínez ha defensat la “transformació digital del Km0”, amb l'esperança que les solucions tecnològiques es transformin i millorin a Euskal Herria. Això suposaria la permanència de les dades. A més, amb les “bones polítiques públiques”, el talent tecnològic també es crearia, es promouria i, si es garantissin les bones condicions, quedaria aquí, en les seves paraules.

No obstant això, considera que a Euskal Herria ja existeix un “ecosistema fort” d'experts en tecnologia, “no diguem en computació lingüística”. Tanmateix, adverteix que si això no se subvenciona tenim “festa”. Entre altres, considera necessari finançar projectes en favor de les tecnologies lingüístiques en basca com GAITEK. “El basc ha de formar part de la transformació digital per a sobreviure, en cas contrari no tindrà futur”.

Martínez espera que la intel·ligència artificial mai s'anticipi a l'ésser humà, “però no serà fàcil”. Diu que la normativa i les lleis han d'ajudar a despertar consciència: “A veure si entre tots som capaços que les tecnologies digitals siguin una eina per a millorar les vides humanes i no el contrari”.

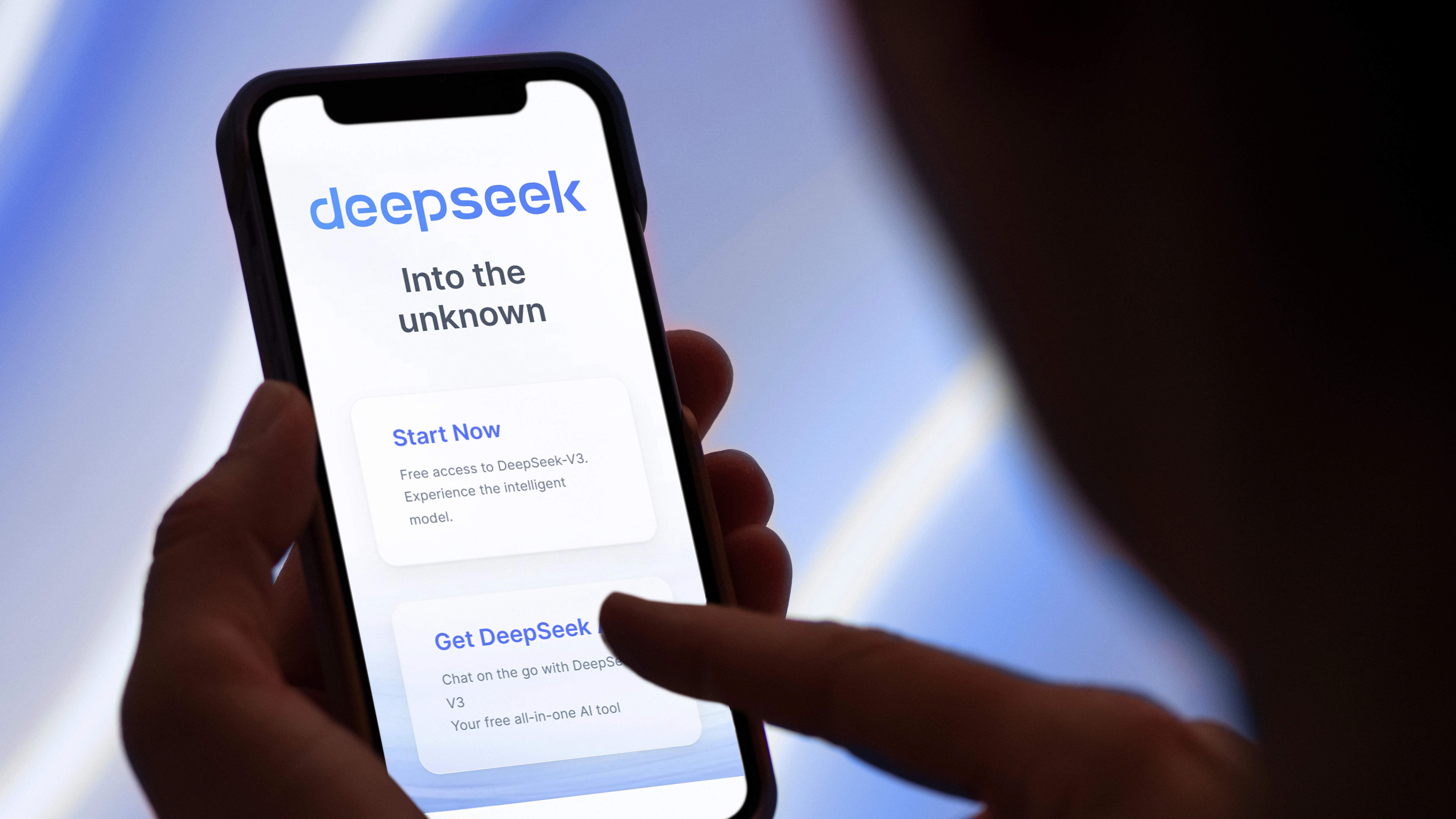

Silicon Valley-ko oligarkia AEBetako gobernura iritsi berritan lehertu da adimen artifizialaren (AA) burbuila. Txip aurreratuen erraldoia den Nvidia-k urtarrilaren amaieran izandako %16,8ko balio galera, egun bakar batean inoiz izan den burtsa balio galerarik handiena da... [+]

Geroz eta ekoizpen gehiagok baliatzen dituzte teknologia berriak, izan plano orokor eta jendetsuak figurante bidez egitea aurrezteko, izan efektu bereziak are azkarrago egiteko. Azken urtean, dena den, Euskal Herriko zine-aretoak gehien bete dituztenetako bi pelikulek adimen... [+]

Diario de Noticias de Álava (DNA) egunkariko langileak sinadura greban daude, eta aspaldi ari dira beren lan baldintza “miserableak” eta horiek kazetaritzaren kalitatean duen eragina salatzen. 2013tik soldatak izoztuta dituzte, eta ordutik erosahalmenaren %30... [+]

«I will overturn, overturn, overturn, it[…]»

Ezequiel 21.27 – King James Version

«Per sobre de tots els algorismes, per sota de tots els

algorismes» Xabier Landabidea

Em sento incòmode, incòmode amb l'actitud gairebé religiosa de la nostra societat cap a la... [+]

Silicon Valleyko enpresa teknologiko handienei zaplazteko ederra eman die DeepSeek-ek. Adimen Artifizialeko chatbot txinatar merke eta berriak zalantzan jarri du AEBen nagusitasuna arlo horretan, eta erakutsi du ez dela milaka milioi diru behar modelo aurreratu eta efizienteak... [+]

Què haig de saber? Amb qui haig de relacionar-me? On haig de viure? Amb aquestes responsabilitats, els éssers humans estem en el camí de viure la idea d'una bona vida en el si de les nostres societats. Si no sabem respondre correctament, per por de quedar-nos en els... [+]

Fa molts anys el Dr. Vaig conèixer l'abusi bot, i també em vaig adonar de la velocitat amb la qual les persones poden enganxar-se a aquestes màquines. Sent animals socials, la relació és natural i necessària, i com diu el nom de 'relació', sempre comporta una resposta per... [+]